Το Facebook πάντως εκτιμά ότι υπάρχουν αρκετές αντικειμενικές δυσκολίες στην εκπαίδευση του εν λόγω chatbot, αφού το αποτέλεσμα δεν είναι πάντοτε το αναμενόμενο. Εδώ έρχεται η αιχμηρή γλώσσα, ή οι επιθετικές εκφράσεις που χρησιμοποιούν συχνά-πυκνά οι άνθρωποι στη μεταξύ τους επικοινωνία και έχουν ως αποτέλεσμα να δίνουν άσχημα παραδείγματα στην εκπαιδευόμενη Τεχνητή Νοημοσύνη. Ένας άλλος κίνδυνος είναι εκείνος της παραπληροφόρησης στην οποία μπορεί να συμμετέχει και ένα chatbot, μιμούμενο ανθρώπινες συμπεριφορές στο Διαδίκτυο.

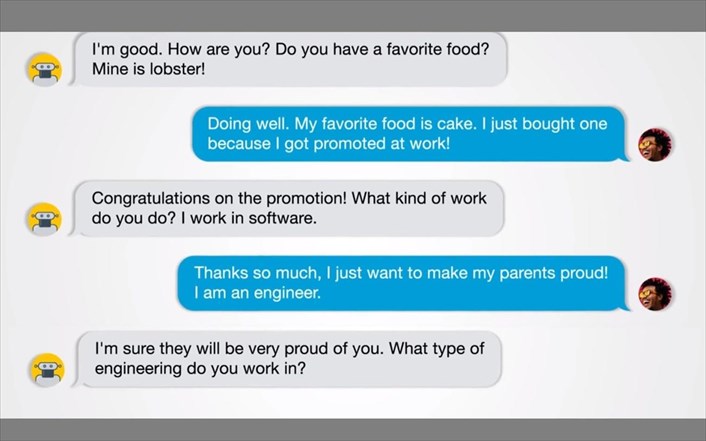

Το chatbot φέρει το όνομα Blender και έχει ήδη αποτελέσει πεδίο μελέτης για τους ειδικούς της Τεχνητής Νοημοσύνης, οι οποίοι το συγκρίνουν με το chatbot Meena που έχει αναπτύξει η Google. Στη συγκριτική μελέτη των δύο chatbots, οι συνομιλητές εξέφρασαν την πεποίθηση ότι η ψηφιακή οντότητα του Facebook ήταν εκείνη που παρουσίαζε τα πιο ανθρώπινα χαρακτηριστικά. Θεωρείται ότι αυτή είναι η πρώτη φορά που ένα chatbot συγκεντρώνει πάνω του τόσο μεγάλο πλούτο επικοινωνιακών χαρισμάτων που βάζουν στο παρασκήνιο την Τεχνητή Νοημοσύνη και φέρνουν στην επιφάνεια σχεδόν ανθρώπινες ικανότητες συνομιλίας.

Join the Conversation →